Aktuell passiert viel gleichzeitig. Die Endphase und der damit verbundene Render-Aufwand laufen simultan zu den Software-Entwicklungen. Nach und nach werden Inhalte fertiggestellt, Softwarefragen gelöst und Konzepte finalisiert.

Die Visuals

Es wird fleißig gerendert! Der limitierendste Faktor ist hierbei sicherlich die Zeit. Gerade bei Simulationen dauert es lange, die Caches vieler tausender Partikel oder Vertices zu berechnen. Solche temporären Dateien können schnell mehrer hundert Gigabyte groß werden, da für jeden Frame die genauen physikalischen Daten aller Objekte abgespeichert werden.

Auch der Zeitaufwand für das Rendern selbst ist nicht zu unterschätzen. Hat man zu niedrige Rendereinstellungen rauscht das Bild oder es wird unschön. Sind sie zu hoch, dauert die BIldberechnung viel zu lange und man verfällt in Zeitdruck. Auch wenn der Rechner Tag und Nacht läuft kann es schon mal sein, dass eine 2-Minuten-Sequenz drei Tage am Stück rendern muss.

Es ist klar, dass man hier keine kurzfristigen Änderungen mehr vornehmen kann. Wenn das Bild einmal final da ist, kann es nicht mehr grundlegend verändert werden. Eine gute Absprache mit der Regie ist also zwingend von nöten.

Die Realtime-Simulationen

Anders sieht es bei den Realtime-Simulationen aus. Wie der Name schon sagt werden diese in Echtzeit berechnet und man kann sie – mit dem nötigen Know-How – in Sekundenschnelle anpassen.

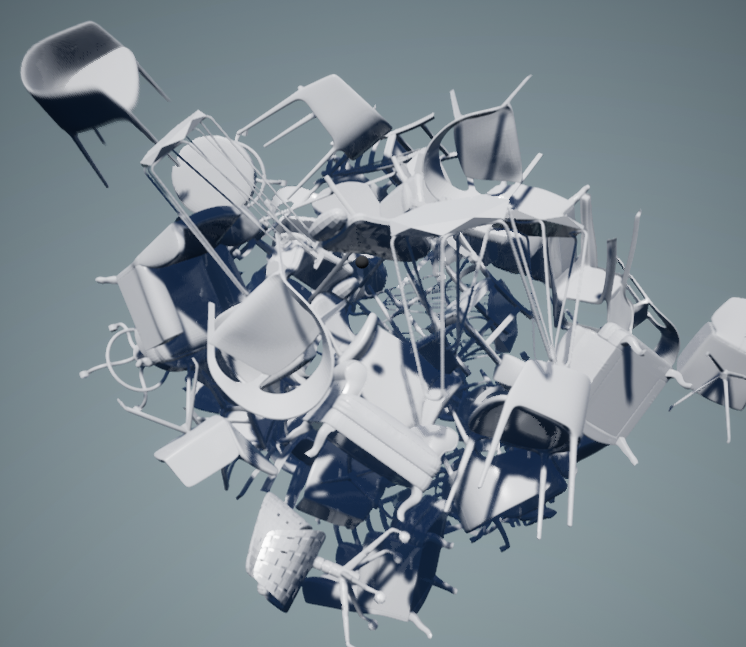

Mittlerweile sind große Teile der Realtime-Einheiten aufgesetzt. Hierbei gibt man dem Programm vor, wie es sich verhalten soll und wie mit den jeweiligen Objekten umgegangen werden soll. Die Objekte selber kann man dann über Referenzen einspeisen und so ganz nach seinen Wünschen erstellen.

Zusammen mit der Regie wurde eine Inhalts-Liste an skurrilen und unwirklichen Objekten erarbeitet, welche nach und nach gemodelt und geshadet werden. Eine Schwierigkeit hierbei ist eine Softwaretechnische Limitierung auf ein Mesh und eine Textur pro Objekt. Hierbei muss man aufpassen, dass man ordentlich arbeitet, sodass sich am Ende keine Probleme und Schwierigkeiten anhäufen.

Die Schnittstelle zur Kontroll-Software wurde ebenfalls bereits hergestellt. Das bildet die Grundlage dafür, dass das Bild auf die Eingaben des Benutzenden reagiert. Das funktioniert in zwei Richtungen: Die Eingabe des Benutzenden muss in die Realtime-Engine eingespeist werden und das Bild muss später an die bildverarbeitende Software zurückgespielt werden. Wir arbeiten hier über OSC einerseits und über Spout andererseits.

Die Software

Desweiteren werden nach und nach die bilderverändernden Module softwareseitig aufgesetzt und vorläufig finalisiert. Wir kommen langsam aber sicher voran, viele Probleme wurden bereits gelöst, Fragen geklärt und die Liste an bevorstehenden Herausforderungen wird allmählich überschaubarer. Mit den Prototypen kann man bereits die ersten Effekte erzeugen und sich ein Bild des späteren, fertigen Produkts machen.

Beitrag von Valentina Knoll und Sophie Kergaßner